Sånn skal NAV bli ledende på AI: – Vil ikke ta jobbene fra ansatte

NAV har funnet ut hva de skal, og ikke skal, bruke AI til. – Generativ AI er imponerende, men fortsatt ikke pålitelig.

I fjor høst uttalte NAV-direktør Hans Christian Holte at NAV skulle være den ledende norske organisasjonen til å ta i bruk AI, og denne uken gikk digitaliseringsminister Karianne Tung ut og sa at 80 prosent av det offentlige skulle bruke AI.

I NAV har de tatt utfordringen på alvor.

Under AI+-konferansen i Halden denne uken fortalte leder for dataseksjonen i NAV IT, Cathrine Phil Lyngstad, at NAV allerede har kommet ganske langt i å finne ut hva de skal bruke AI til. Og ikke minst: Hva de ikke skal bruke det til.

– Forrige uke fikk NAV sin første offisielle AI-strategi, som er støttet av alle avdelinger i NAV, sa Lyngstad.

Lyngstad kunne fortelle at de har utforsket AI i mange år. I 2016 lanserte de en big data-lab, i 2017 en AI-lab, før man rundt 2018 begynte å diskutere hvordan man kunne skape verdi med AI.

NAVs fire AI-mål

Lyngstad var veldig klar på at bruk av AI i NAV krever ekstra forsiktighet, siden NAV ofte behandler svært sensitive persondata.

– Ansvarlig AI har vært viktig for oss. Det er også en viktig del av den nye strategien vår.

Hun viste blant annet til at NAV i august i fjor kom med en veileder for hvordan AI kan brukes på en ansvarlig måte, og at de har interne retningslinjer for AI-bruk.

– Vi diskuterte å forby generativ AI, men fant ut at det har vi ikke sjans til å gjøre. Så da vil vi heller redusere risikoen.

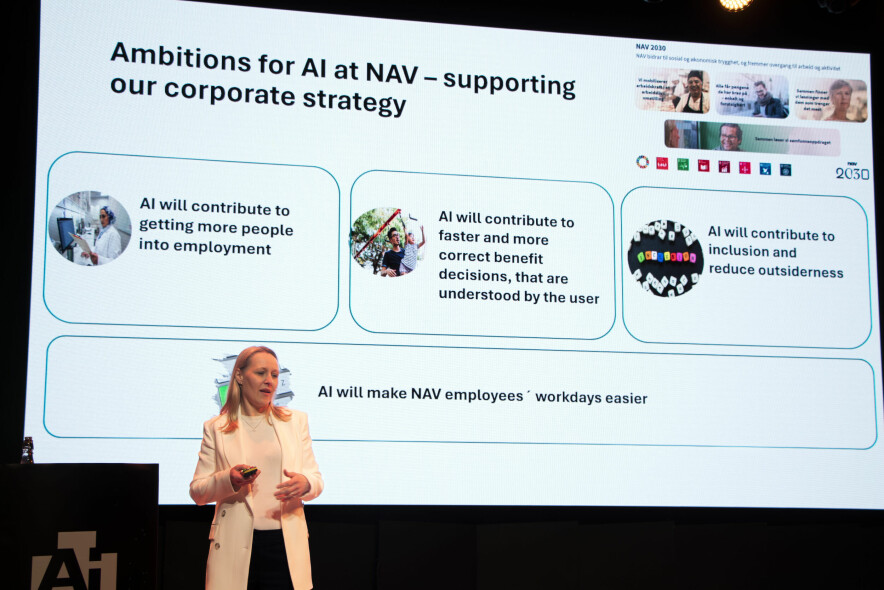

Lyngstad presenterte fire hovedmål i den nye AI-strategien – der alle handler om å gjøre livene bedre for både NAV-brukere og NAV-ansatte:

- «AI vil bidra til å få flere mennesker i arbeid»

- «AI vil bidra til raskere og mer korrekte beslutninger om ytelser fra NAV, og beslutninger som forstås av brukerne»

- «AI vil bidra til bedre inkludering og til å redusere utenforskap»

- «AI vil forenkle arbeidshverdagen til NAV-ansatte»

AI skal ikke ta beslutninger alene

Mange er bekymret for at AI kommer til å ta jobber fra mennesker. For en virksomhet som i praksis har som oppgave å få flere – ikke færre – mennesker i arbeid, er det naturlig nok viktig å være bevisst på hvordan AI påvirker dette.

– AI vil ikke ta jobbene fra NAV-ansatte. Det kan være noen få unntak, men generelt vil det bare gjøre arbeidsdagen til ansatte enklere, sa Lyngstad.

Og selv om NAV har ambisjoner om å bruke AI til veldig mye, er det én ting AI ikke skal brukes til – i hvert fall ikke på det nivået teknologien er nå:

– AI skal ikke brukes til å ta beslutninger om hvilke ytelser brukere skal få. Men vi tror det kan være veldig bra for beslutningsstøtte, sa Lyngstad.

Enklere å finne informasjon

NAVs utviklere har allerede flere konkrete AI-prosjekter på gang.

Ett av dem er å se på hvordan AI kan brukes for å redusere utenforskap og inkludere mennesker som kanskje i dag sliter med å finne frem i jungelen av informasjon og regler.

NAVs tester derfor ut å bruke AI til å finne frem i informasjon, hente frem relevante lenker til brukeren og oppsummere informasjonen for å gjøre den enklere å forstå.

– Det er nyttig, forståelig, og korrekt – mesteparten av tiden. Generativ AI er imponerende, men fortsatt ikke pålitelig, sa Lyngstad.

Generativ AI er imponerende, men fortsatt ikke pålitelig.

Datatilsynet sa nei

I ett av prosjektene så NAV på hvordan man kunne bruke AI til å hjelpe ansatte som jobber med å vurdere sykemeldinger. AI kunne blant annet brukes til å se hvem som har behov for oppfølging, og i tillegg kan løsningen brukes til å sikre at det ikke foregår ubevisst diskriminering av enkelte grupper brukere.

– En av utfordringene vi så var at vi ikke har lov til å teste og sjekke hvorvidt vi diskriminerer uføre, hvis vi ikke har informasjon om deres funksjonshemminger som en del av prosessen.

Datatilsynet konkluderte i januar 2022 med at NAV har lov til å bruke AI som beslutningsstøtte, men at det er usikkert om det vil være lovlig å bruke personopplysninger til å utvikle selve modellen.

– Vi ser også at standardene vi setter for AI er høyere enn for mennesker. Vi vet at mennesker gjør feil, men vi aksepterer ingen feil svar fra en maskin.