Denne Apple-nyheten lar deg scanne alt i 3D

- Hva med å skanne en hel LEGO-by man har bygget, drømmer Shortcut-utviklere Magnus Tviberg og Petter Wright.

WWDC, Apples konferanse for utviklere gikk nylig av stabelen, og med den kom en rekke blikk inn i fremtiden.

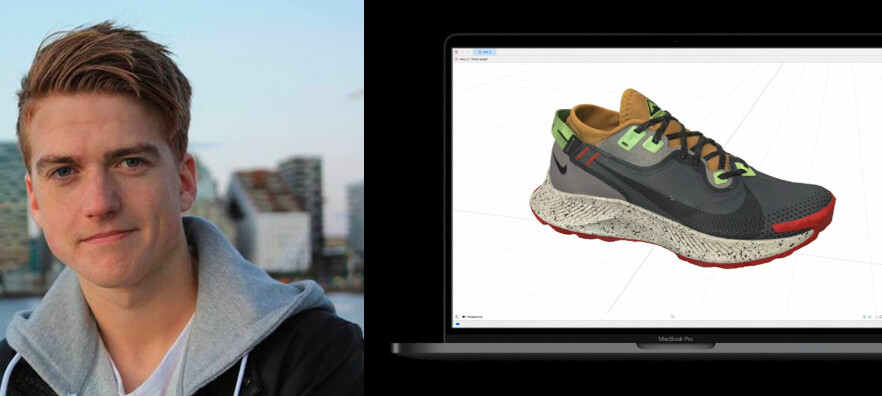

En av de mest spennende teknologiene vi fikk en snikktitt på var Object Capture API-et, som snart skal la Apple-brukere scanne gjenstander i den ekte verden og få dem omgjort til tredimensjonale datamodeller.

Petter Klingen Wright og Magnus Tviberg i det norske utviklerhuset Shortcut spår en lys fremtid for teknologien.

Gir 3D til vanlige folk

Wright og Tviberg forteller at Object Capture API-et kan brukes til å skape elementer i en utvidet virkelighet - altså teknologi hvor man bruker kameraet på telefonen til å filme den virkelige verden og samtidig plasserer 3D-elementer i den - uten å bruke masse penger på å få laget 3D-modeller fra grunnen av.

Det vil gi helt vanlige mennesker muligheten til å lage 3D-modeller av deres egne gjenstander.

Tradisjonelt er 3D-modellering en kostbar affære hvor profesjonelle skulptører gjerne bruker dager og uker på å gjengi gjenstander fra den virkelige verden. Men Wright og Klingenberg tror ikke 3D-designere trenger å skjelve i buksene helt ennå.

- 3D-designere trenger nok ikke skjelve i buksene helt enda, da modellene man lager ikke kommer til å ha de mest fancy animasjonene eller avanserte interaksjonene. Dette kan man potensielt legge til i modellene etterpå. I absolutt beste fall kan det gi et startsted for 3D-designere.

Gjengen forteller at teknologien er perfekt om man lager et spill og vil ta utgangspunkt i noe man har stående i stua, eller finner en lampe på et bruktsalg som man gjerne skulle hatt med i kortfilmen man lager.

- En annen aspekt av 3D-modeller som er interessant er skaleringen. Hva med å skanne en hel LEGO-by man har bygget, for så å gå igjennom byen ved bruk av utvidet virkelighet, forteller de ivrig.

- Det kan hende at vi snart kommer til et punkt der man forventer å kunne se en 3D-modell av produkter.

Kan forenkle kjøpsprosessen på Finn.no betraktelig

Wright og Tviberg forteller at en av bruksområdene for det nye Object Capture API-et kan bli å finne ut av størrelsen på gjenstander.

De forteller at en av kundene deres er Finn.no, hvor det er vanlig at selgere får spørsmål om størrelsen på en vare fra potensielle kunder.

- Er det plass til dette bordet ved siden av sengen min? Med Object Capture vil 3D modellene være riktig skalert sånn at de er like store som gjenstandene de representerer. Dette kan forenkle kjøpsprosessen betraktelig.

Gjengen tror at Apple sin strategi er at denne teknologien skal leve nettopp i tospann med Apples statsing på utvidet virkelighet, som Apple kaller ARKit.

- AR-briller har vært snakk om lenge, og nå som Apple har fått skikkelig orden på å utvikle egne, kraftige prosessorer, så står det meste klart for den neste interaksjonsrevolusjonen.

Dessverre ble ikke brillene lansert på årets WWDC-konferanse, slik mange håpet på.

- Det er også mulig å se dette i sammenheng med de andre WWDC-lanseringene som handler om å være sammen, uten å være fysisk sammen. Å vise ting i 3D kan være mer engasjerende, både for folk på skolen og de som vil lage litt mer fancy presentasjoner.

Kjip begrensning

Men, det er dessverre ikke like rett frem å bruke denne teknologien som man skulle håpet. Wright og Tviberg forteller at det er noen ganske kjipe begrensninger foreløpig.

- Siden Object Capture API-et slik det er nå ikke kan generere 3D modeller på mobilen blir nok prosessen litt for avansert for de aller fleste brukere.

Det er nemlig kun de nyeste Mac-datamaskinene med høye spesifikasjoner som støtter teknologien foreløpig, nærmere bestemt Mac-er som kjører macOS 15 med Apple Silicon eller Intel Macer med 4GB AMD og 16GB RAM.

Derfor tror gjengen det blir leverandører og produsenter som i første omgang lager 3D-modellene, ikke brukerne selv. For eksempel i en app som har pizzameny for en restaurant.

- Det kan hende at vi snart kommer til et punkt der man forventer å kunne se en 3D-modell av produkter man vurderer å kjøpe, forteller de.